Három az egyben architektúra

Az Nvidia fejlesztése három különböző MI-architektúrát ötvöz. A Hybrid Mamba-Transformer modell Mamba-2 és transformer rétegeket váltogat, ami különösen előnyös a hosszú távú adatfeldolgozás során. Tipikus eset, amikor egy nagy pénzügyi adathalmazban vagy forráskódban kell gyorsan és pontosan kell keresni: a Mamba-2 rétegek gyors bejárást tesznek lehetővé, míg a transformer rétegek globális horgonyként, pontos visszakeresést biztosítanak.

A hagyományos Mixture-of-Experts (MoE) modellekkel szemben a Nemotron 3 Super „Latent Mixture-of-Experts” (LatentMoE) rendszert használ: a tokeneket előbb egy sűrített térbe vetíti, majd így irányítja szakértőkhöz, négyszer annyi szakértőt vonva be ugyanannyi számítási költséggel. Ez különösen hasznos, amikor például Python-kód, SQL vagy természetes nyelv között kell gyorsan váltani.

Mindezt tovább gyorsítja a Multi-Token Prediction: egyszerre több következő elemet jósol, így akár háromszoros sebességnövekedést ér el kódgenerálásban vagy eszközhasználatban.

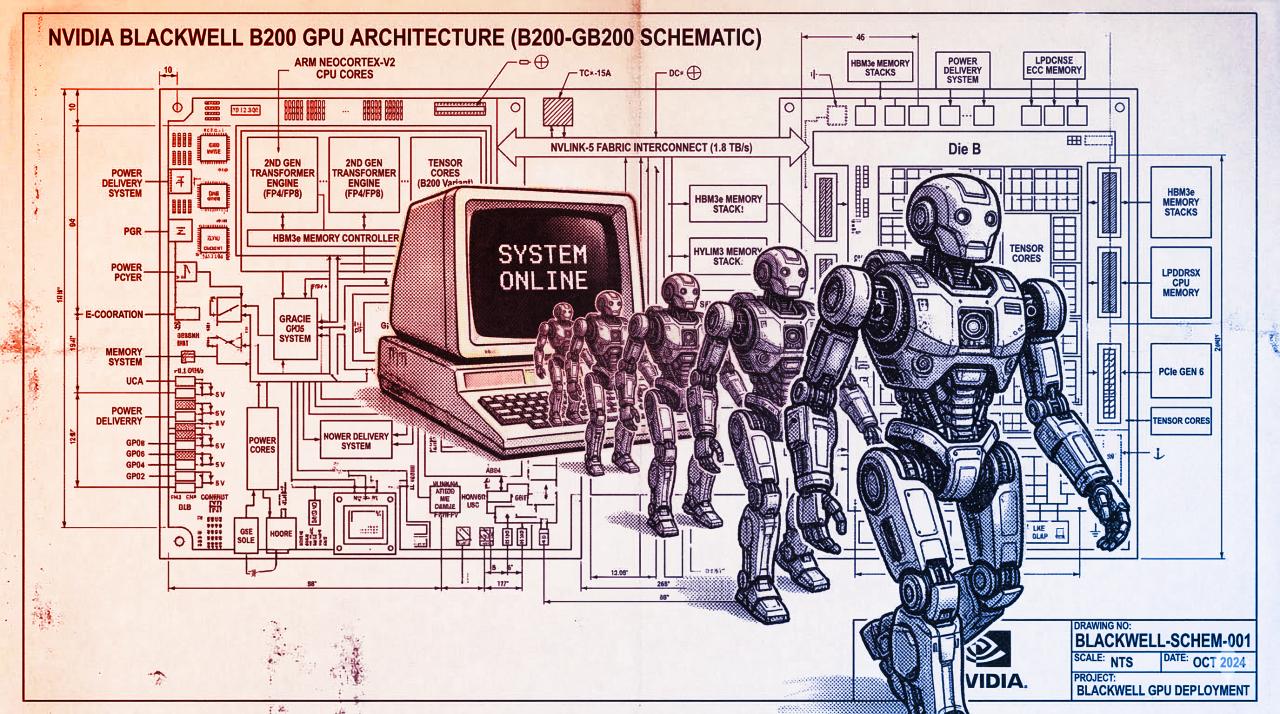

Blackwell GPU és teljesítménymutatók

A vállalati szektor számára az igazi áttörést a Blackwell GPU-ra optimalizált működés hozza. Az NVFP4 (4 bites lebegőpontos) előtanításának köszönhetően a Nemotron 3 Super a Hopper architektúrán futó 8 bites modellekhez képest négyszer gyorsabb, mindezt anélkül, hogy pontosságot veszítene.

A modell az élen áll a DeepResearch Bench benchmarkján, amely az MI komplex, többlépéses kutatási képességét teszteli nagy dokumentumhalmazokon. A Nemotron 3 Super több területen kiemelkedő teljesítményt mutat: például 1 millió token hosszúságú szövegeket kezel, és strukturált feladatokban akár 7,5-szer is gyorsabb, mint egyes versenytársai.

A különböző teszteredmények vegyesek, de általánosságban a Nemotron 3 Super kiemelkedik ügynökalapú feladatokban, hosszú szövegfeldolgozásban és valós idejű alkalmazásokban is, vagyis széles körű, vállalati szintű MI-munkafolyamatokat támogat.

Nyitott, de nem teljesen szabad licenc

Bár a modell szabadon elérhető kereskedelmi felhasználásra, az Nvidia a saját „open model” licencét alkalmazza, szigorúbb feltételekkel, mint egy tipikus open-source licenc. Vállalati felhasználók jogosultak a modellt termékekben használni, továbbértékesíteni, sőt saját, testre szabott verziót is készíthetnek – feltéve, hogy feltüntetik az Nvidiát forrásként. Fontos azonban, hogy a licencek automatikusan megszűnnek, ha valaki megsérti a beépített biztonsági korlátokat, vagy pert indít szellemi tulajdon megsértése miatt az Nvidiával szemben. Ennek következtében az Nvidia egyszerre ösztönzi a fejlesztéseket és védi saját érdekeit.

Vállalati integráció és iparági támogatás

Az Nvidia újdonsága jelentős visszhangot keltett a fejlesztők között: a gyártó 10 billió tanítóadatot és részletes oktatóanyagokat is kiadott a modellel együtt. Felhős és helyi alkalmazásokban egyaránt bevethető: már elérhető a Dell AI Factory, a HPE, a Google Cloud és az Oracle környezetében, valamint hamarosan az AWS és az Azure környezetében is.

Számos iparági szereplő használja szoftverfejlesztésre, nagy kódbázisok elemzésére és ipari automatizálásra is: többek között a Siemens és a Palantir is a Nemotron 3 Supert választotta.

Ahogy a gyártónál fogalmaztak: a chatbotokon túlmutató vállalati MI-feladatok egyre nagyobb adat- és tudásterhet rónak a rendszerekre. A Nemotron 3 Super csökkenti ezek kezelési költségét, és új szintre emeli a skálázott mesterséges intelligenciát.