Mit tud egy beágyazási modell?

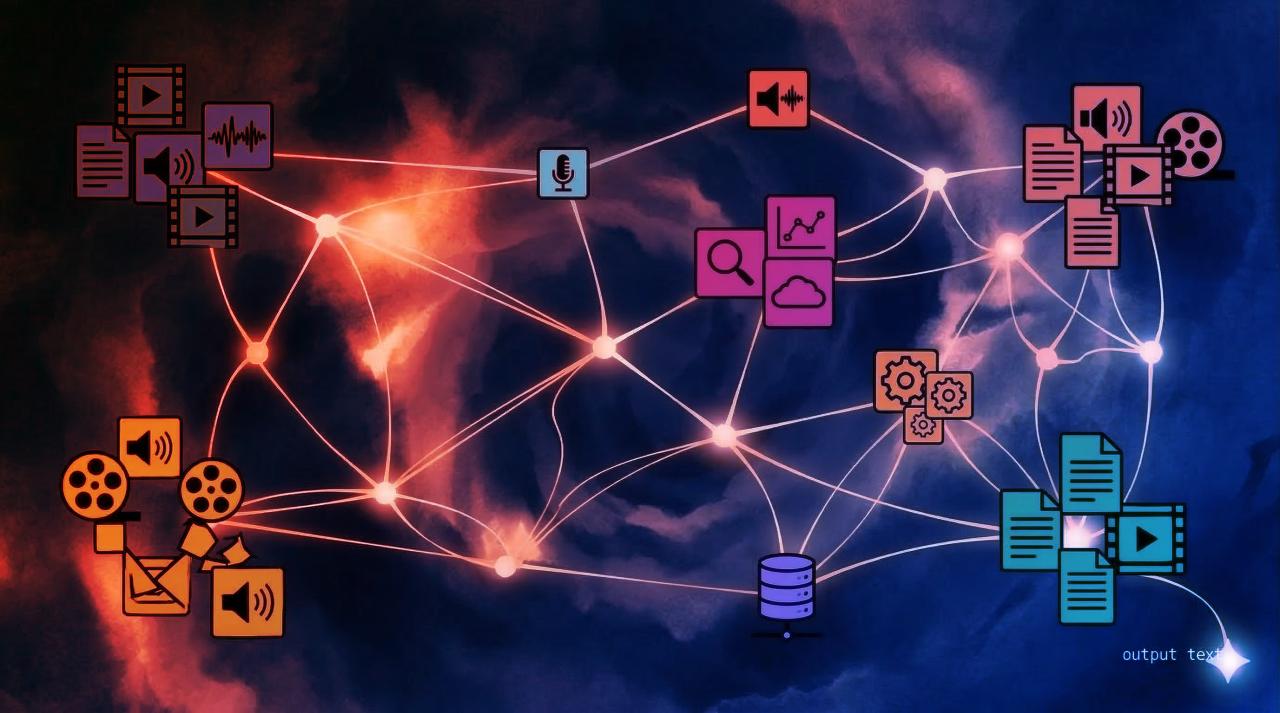

A beágyazási (embedding) modellek az MI láthatatlan motorjai: a legösszetettebb adatokat – mondatokat, képeket, hangrészleteket – alakítják át hosszú számsorokká, azaz vektorokká. Ezek a számok valójában egy sokdimenziós gondolattér koordinátáit jelentik. Két eltérő típusú adat, például a „kutya” szó és egy golden retriever fotója is egymás mellé kerül, ha jelentésük közeli.

Ma már keresők, ajánlórendszerek (Netflix, Spotify) vagy vállalati asszisztensek (Retrieval‑Augmented Generation – RAG) is ezen alapulnak: a vállalati dokumentumokat, képeket, hangokat így tudja egy MI egyetlen kérdés alapján összekapcsolni.

A szóalapú vektorreprezentáció ötlete az 1950‑es évekre vezethető vissza, ám csak 2013‑ban jött az igazi áttörés – a Google a Word2Vec modellt vezette be, ami új iparági standardot teremtett. Ma ezt a piacot a Google, az OpenAI, az Anthropic és a Cohere uralják.

Miért forradalmi a Gemini Embedding 2?

A legtöbb beágyazási modell eddig szinte kizárólag szöveggel dolgozott. Hiába akartál például videóra keresni, előbb ki kellett vonni belőle a szöveget, majd ezen futott a keresés. A Gemini Embedding 2 viszont alapból multimodális: képes a képeket, hangokat, videókat, dokumentumokat és szöveget közvetlenül, ugyanabban a 3072 dimenziós térben ábrázolni.

Ez azt jelenti, hogy mostantól nincs szükség külön pipeline‑ra a képekhez, videókhoz, szövegekhez. Egy egyszerű kereséssel egy időben találhatsz rá egy meghatározott pillanatra egy videóban, egy képre vagy akár egy hangrészletre. A rendszer egyes kérésekben kevert bemenetekkel is megbirkózik. Így például egy vintage autót ábrázoló fotóval és a „Mi a motor típusa?” kéréssel egyszerre lehet dolgozni, nem kell szétválasztani a médiaformátumokat.

Egy speciális újítás a Matryoshka Representation Learning, amely lehetővé teszi, hogy a vektor leglényegesebb információi már az első néhány számban benne legyenek, így a vállalatok akár a 3072 helyett 768 vagy 1536 dimenziós vektorokat is használhatnak, optimális tárhellyel, csekély pontosságvesztéssel.

Teljesítmény és gyakorlati eredmények

A Gemini Embedding 2 új szintet jelent a multimodális keresésben és leképezésben. Főleg videó‑ és hangalapú keresésben mutatja meg erejét: nem igényel közbeiktatott szöveges átiratokat, így pontosabban tudja összekapcsolni a vizuális és auditív jelentéseket.

A legnagyobb előnyök:

– A szöveg‑kép, szöveg‑videó, szöveg‑hang keresésben stabilan veri az iparági versenytársakat.

– Natív audiófeldolgozásban kiemelkedő, jobban megragadja a kimondott szavak érzelmi és intonációs tartalmát is.

– Hosszú dokumentumok (8192 token) kezelése sem jelent problémát, így egy 6 oldalas PDF‑nek is van értelme.

– A Matryoshka technológiának köszönhetően még lecsökkentett, 768 dimenziós vektorokkal is jobb a teljesítménye, mint sok fix méretű konkurensnek.

Mit jelent ez a vállalati adatbázisokra nézve?

Az eddig megszokott különálló pipeline‑okat egyetlen egységes tudásbázissá olvaszthatod össze. Egy ügyfélprobléma – amiben hangfelvétel, képernyőkép, szerződés PDF és e‑levelezés is előkerülhet – most már egyetlen kereséssel feltérképezhető.

Első felhasználók között a Sparkonomy platform 70%-os késleltetéscsökkenést jelentett: MI‑asszisztensüknek már nem kellett a modellek között „lefordítani” az adatot, hanem rögtön értelmezte a multimodális keresést. Az Everlaw jogi techcég szerint minden eddiginél több „füstölgő fegyver” bizonyíték jött elő, hisz a képek és videók is azonnal kereshetővé váltak.

Korlátok és bemeneti limitációk

Fontos látni: a rendszer nem mindenható. Egyetlen kéréssel maximum 8192 tokennyi szöveget, 6 képet, 128 másodperc videót (2 perc 8 másodperc), 80 másodperc natív hangot (1 perc 20 másodperc), illetve 6 oldalas PDF‑et lehet beadni. Ha például egy 100 oldalas szerződést kell feldolgozni, azt 6 oldalas szeletekre kell vágni, és így kell feltölteni.

Videók és hanganyagok esetén ugyanígy: például egy 10 perces videót nyolc részre kell bontani, és részletekben lehet beágyazni. Ezek tehát nem tárhelyi, csak kérésekkénti korlátok – minden szegmens vektorként ugyanabban az adatbázisban kereshető lesz.

Árazás, licenc, elérhetőség

2026. március 10‑től a Gemini Embedding 2 nyilvános előzetesként érhető el minden fejlesztőnek és cégnek. Elérhető a Google két fő MI‑kapuján keresztül: gyors prototípusokhoz azonnal elindítható, nagyvállalati alkalmazásoknál pedig Google Cloud‑integrációval, fejlett biztonsági és skálázási támogatással működik.

Beépült a főbb MI‑infrastruktúra‑könyvtárakba (LangChain, LlamaIndex, Weaviate stb.), nagyon egyszerűvé téve az átállást meglévő projektekben.

Az árképzés kétlépcsős:

– Az ingyenes szint 60 kérés/perc kapacitással próbaverzióként szolgál azoknak, akik kísérletezni akarnak.

– Termelési (production) használatban minden 1 millió tokennyi szöveg/kép/videó után 90 HUF, hang esetén 180 HUF (mert a nyers hangfeldolgozás dupla erőforrást igényel) számlázódik.

Nagyvállalatoknál a Vertex AI platformon „Pay‑as‑you‑go”, vagyis használatalapú díjazás él, beállítható fix, garantált sávszélességgel, és akár nagy tömbök kötegelt átkódítására is alkalmas.

A Python kódot tartalmazó dokumentáció és példák Apache 2.0 licenc alá esnek, így szabadon módosíthatók, beépíthetők saját rendszerekbe – semmi jogdíj, semmilyen kötelező visszaosztás.

Migrálni vagy nem migrálni?

A döntés az adatosztályvezetőknél és technikai vezetőknél van: ha eddig széttagolt pipeline‑okra, köztes modellekre támaszkodott a szervezet, az átállás stratégiai előnyhöz juttathat. Nincs több „lebutító átírás”, kevesebb ponton csúszik el a jelentés – ezt már a Sparkonomy is tapasztalta.

Az átállás a meglévő ipari szoftverintegrációknak köszönhetően sokszor csak minimális kódmódosítást igényel. Az igazi „költöztetés” abban áll, hogy a régi adatbázist újra kell beágyazni a 3072 dimenziós térbe: ez egyszeri számítási kihívás, de utána valóban keresztmédias keresés, gyorsabb és precízebb találati arány lesz a végeredmény.

A Matryoshka technológiával pedig különböző típusú felhasználásokhoz a pontosság vagy a költség optimalizálható: a kritikus jogi kereséseket maximális pontosággal, a kevésbé fontos ajánlórendszereket kisebb, olcsóbb vektorokkal lehet futtatni.

Összefoglalásként megjegyezhető, hogy aki igazán komplex, sokféle médiát érintő, kereshető tudásbázisra, gyorsabb lekérdezésre és kevesebb veszteségre vágyik, annak a „szöveg‑plusz” világból érdemes a Gemini Embedding 2 multimodális világába migrálni. A költségek gyorsan visszajönnek a pontosabb válaszok és a letisztultabb MI‑architektúra révén – a nagyvállalati informatika most lép a következő korszakba.