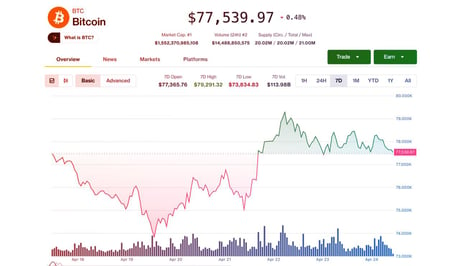

Drasztikus árzuhanás, új MI-gazdaságtan

Az új DeepSeek-V4 nemcsak technológiai szempontból jelent áttörést, hanem üzletileg is. Példamutató API-áraival kihúzza a talajt a prémium MI-szolgáltatások alól: egymillió bemeneti token ára 1,74 dollár (kb. 635 Ft), a kimeneti tokenekért 3,48 dollárt (kb. 1270 Ft) kell fizetni, vagyis összesen 5,22 dollár (kb. 1907 Ft) egymillió bemeneti és kimeneti tokenre – míg az OpenAI legújabb GPT-5.5-je ugyanezért 35 dollárt (kb. 12 800 Ft), az Anthropic-féle Claude Opus 4.7 pedig 30 dollárt (kb. 11 000 Ft) kér. Más szóval, a DeepSeek-V4 használata akár egyhatoda lehet a vezető nyugati szolgáltatók költségének, de a Flash-verziónál az árkülönbség még drasztikusabb. Ebből adódóan a költségérzékeny vállalatok és fejlesztők hirtelen rengeteg automatizációs, elemzési vagy ügyfélszolgálati MI-felhasználást gazdaságosan valósíthatnak meg, amiről eddig csak álmodtak.

Megközelítőleg piacvezető intelligencia

A DeepSeek-V4 Pro Max főként abban emelkedik ki a mezőnyből, hogy a teljesen nyílt modellek közt igazi nagyágyúnak számít – ráadásul komolyan megszorongatja a zárt, vezető modelleket is. Több standard teszten, például a BrowseComp webes böngészéssel kapcsolatos feladatban szinte ugyanazt tudja, mint a GPT-5.5 (DeepSeek: 83,4%, GPT-5.5: 84,4%, Claude Opus 4.7: 79,3%), más területen viszont kis hátrányban van (például a GPQA Diamond és a Humanity’s Last Exam logikai mérésein). A szoftvermérnöki, ügynökjellegű vagy hosszú szövegkörnyezetet igénylő feladatokban a nagy modellek még vezetnek, de a DeepSeek most már veszélyesen közel került. Ráadásul az árkülönbség miatt a fejlesztők újratervezhetik, hogy mire éri meg MI-t alkalmazni.

Óriási előrelépés a DeepSeek korábbi modelljeihez képest

Összehasonlítva a DeepSeek V3.2-vel, a V4 ugrásszerű fejlődést mutat: a szakértelmet és világismeretet mérő teszteken akár 10–20 százalékpontos javulásokat láthatunk, míg bizonyos matematikai és programozói feladatokban még nagyobb az előrelépés. A hosszú szövegkezelésben (akár egymillió tokenes kontextussal) is jelentőset lépett előre a rendszer, miközben jelentősen csökkent a szükséges hardverigény és memóriahasználat.

Forradalmi újítások a „10 sávos autópályás” architektúrában

A DeepSeek fejlesztői mertek radikálisan új irányt venni: az 1,6 billió paraméteres Mixture of Experts architektúrában egyszerre akár csak 49 milliárd paraméter aktiválódik tokenenként, ezzel komoly erőforrás-megtakarítást, de magas tudássűrűséget érnek el. A Hybrid Attention-felépítés és a Manifold-Constrained Hyper-Connections (mHC) lehetővé teszi, hogy a modell egyszerre hatalmas mennyiségű információt kezeljen, miközben nem fullad össze, nem vész el a részletekben. Ennek köszönhetően a rendszer digitális forgalomirányítóként működve képes a komplex feladatok kezelésére, és stabil, gyors tanulást mutatott óriási adatmennyiség mellett is.

Három üzemmód egy rendszerben: intuíciótól a szupergondolkodásig

A DeepSeek-V4 külön érdekessége, hogy háromféle „gondolkodási” módot kínál: a gyors, alapfeladatokra optimalizált válaszadás mellett egy logikai elemzésre kihegyezett üzemmódot, illetve egy „Think Max” opciót, amely a legbonyolultabb problémákban is a vezető modellek szintjéhez közelít – de még mindig rendkívül olcsón. Ez a rugalmasság lehetővé teszi, hogy a fejlesztők az igények alapján válasszanak teljesítmény és ár között.

Felszabadulunk az Nvidia GPU-k szorításából?

Az új DeepSeek-modell nemcsak architekturálisan, hanem hardveroldalról is forradalmi lehet. A fejlesztők sikeresen tették skálázhatóvá a modellt kínai Huawei Ascend processzorokon és más alternatív architektúrákon is, így a drága, gyakran exportkorlátozott Nvidia-kártyáktól részben függetlenedni lehet. Ez különösen fontos lehet olyan országokban vagy vállalatoknál, ahol kulcskérdés az ellátásbiztonság.

Szabad felhasználás, fejlesztőbarát környezet

A DeepSeek-V4 MIT-licenc alatt érhető el: mindenki szabadon letöltheti, használhatja, módosíthatja, sőt kereskedelmi célra is alkalmazhatja, ellentétben a legtöbb konkurens, „korlátozottan nyílt” MI-modellel. A fejlesztői dokumentációban részletes Python-mintakód segíti az integrációkat, a „Think Max” módban pedig óriási kontextusablakokat javasolnak a maximális eredmény érdekében. A modellt számos ügynökrendszerrel (Claude Code, OpenClaw, OpenCode) natívan össze lehet kötni, ezzel is szélesítve a fejlesztői ökoszisztémát.

Kiütés az MI-piacon: sokk és paradigmaváltás

A DeepSeek-V4 megjelenése sokkolta a szakmát. A közösségi platformokon a „visszatért a bálna” kommentek és megerősítések jelzik: mostantól teljesen más MI-költségszámítással lehet számolni. Szakértők szerint a DeepSeek sikeresen kényszeríti az eddigi nagy szereplőket, hogy alaposan átgondolják árpolitikájukat, hiszen a nyílt fejlesztés és az olcsóság összekapcsolása mindenkihez közelebb viszi a csúcstechnikát. A vállalat közben le is állítja a régi rendszerek támogatását, minden forgalmat az új V4-Flash architektúrára irányítanak át.

Más szóval, ez az új korszak nemcsak a kutatók és cégek, hanem a világ összes MI-felhasználója számára – immár hozzáférhető áron – elhozhatja a valóban intelligens rendszerek mindennapjait.