Forradalmi memóriatakarékosság

Mindeközben a Google mérnökei egy egészen új szintre emelték ezt a memóriakezelést, amikor bemutatták a TurboQuant nevű rendszert. Ezzel a megoldással akár hatszor kevesebb működés közbeni memóriát is elegendő használni anélkül, hogy az MI elveszítené a teljesítményét vagy pontosságát. A trükk kulcsa a kvantizáció — olyan tömörítési eljárás, amelynek során a memóriában tárolt adatokat kevesebb biten, egyszerűsítve, de elég pontosan lehet újra leírni.

A módszert eddig is alkalmazták statikusan, vagyis az egész rendszert egyszer tömörítették a futtatás előtt. Ám a TurboQuant igazi újítása a dinamikus, folyamatos tömörítés: a rendszer valós időben igazítja a kulcs–érték gyorsítótár tartalmát, miközben az MI válaszokat generál. Ez jelentős szoftvermérnöki bravúr, mert a tömörített adatok hibátlan frissítése eddig számos cégnél akadály volt. A Google tesztjei alapján a Meta Llama 3.1-8B, a Google Gemma és a Mistral modelleken is kiváló eredményt hozott, sőt keresőmotoroknál és MI-alapú szolgáltatásoknál is forradalmi lehet.

Hogyan spórol a TurboQuant memóriát?

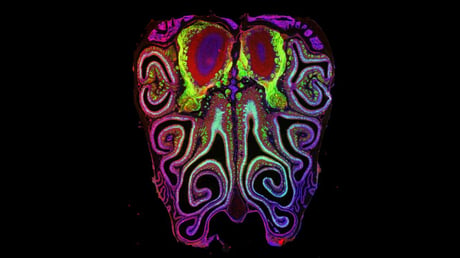

A TurboQuant két fő technikát alkalmaz. A PolarQuant során az MI adott pont körüli szögekké konvertálja az adatokat a hagyományos térbeli koordináták helyett — ez egyszerűbbé, tömörebbé teszi a leírást. Ezután lép közbe a Johnson–Lindenstrauss-féle (QJL) optimalizáció, amely apró igazításokkal korrigálja a kvantizációból eredő kerekítési hibákat. Így kevesebb memórián is pontos marad az információ.

A fejlesztés jelentőségét jól mutatja az is, hogy amikor a Google március 24-én először beszélt a TurboQuantról, a legnagyobb memóriagyártó cégek, mint az SK Hynix és a Samsung részvényei zuhanni kezdtek. Sokan ezt az áttörést a kínai DeepSeek MI-modell váratlan feltűnéséhez hasonlították, amely olcsón nyújtott világszínvonalú teljesítményt.

A valóságban: laborból a mindennapokba

A most bemutatott eljárás egyelőre főként a chatbotok válaszgenerálásánál, vagyis az úgynevezett inferencia szakaszban hoz jelentős megtakarítást. A tanulási szakasz — amikor az MI új ismereteket dolgoz fel — továbbra is hatalmas memóriát igényel majd. Így a teljes memóriaigény csökkenése összességében nem lesz drámai mértékű, de a válaszgenerálás gyorsulása, a nagyobb szövegkörnyezet és a pontosság mindenképpen nagy ugrást jelent.

A TurboQuant hivatalos bemutatóját az IEEE Nemzetközi Akusztika-, Beszéd- és Jelfeldolgozás-konferencián tartották Rio de Janeiróban, míg a PolarQuant és QJL módszereket május elején prezentálják Tangerben, a Nemzetközi Reprezentációtanulási Konferencián. Ez a fejlesztés új korszakot nyithat a miniatűr, de hatékony MI-k világában.