Vége a pániknak, jön a racionalizáció

Már a nagyvállalatok is szembesülnek a ténnyel: az egyesített GPU-kapacitásokat évek óta csak halmozzák, valós kihasználtságot azonban alig tudnak mögé tenni. A „sosem elég a GPU” narratíva helyett hamarabb lett prioritás a már meglévő park hatékonyabb működtetése és a méregdrága, de tétlenül álló eszközök gazdasági megtérülése.

A legfrissebb piaci felmérések igazolják: az elméleti kapacitáshoz képest a tényleges termelékenység elképesztően gyenge. Megváltozott a döntési logika is: a szolgáltató választásánál már nem a gépigény az elsődleges szempont, hanem az integráció a meglévő rendszerekkel, a biztonsági és szabályozási megfelelés, illetve a teljes bekerülési költség (TCO) – utóbbi egy negyedév alatt 34%-ról 41%-ra ugrott a céges szempontlistán.

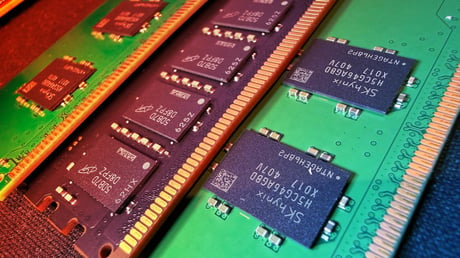

GPU-t venni már nem menő – produktivitást kell hozni

A GPU-k kihasználatlansága többé nem „óvatossági tartalék”, hanem súlyos pénzügyi veszteség. A sikeres MI-fejlesztés már nem a kapacitás felhalmozásáról, hanem a hatékonyság maximalizálásáról szól. Egyre több cég mondja ki: nem akarjuk kifizetni azt, amit nem használunk ki. A hangsúly a „GPU-aktivitásról” a „GPU-produktivitásra” kerül – vagyis arra, hogy adott pénzből mennyi hasznos eredményt, tokent (azaz kimenetet) tud termelni a rendszer.

Ma már luxusnak számít a kihasználatlan erőforrás. Az új korszak vezetői nem újabb GPU-t vesznek, hanem a már meglévő parkból hoznak ki többet, erre specializált költségoptimalizáló platformokat használva.

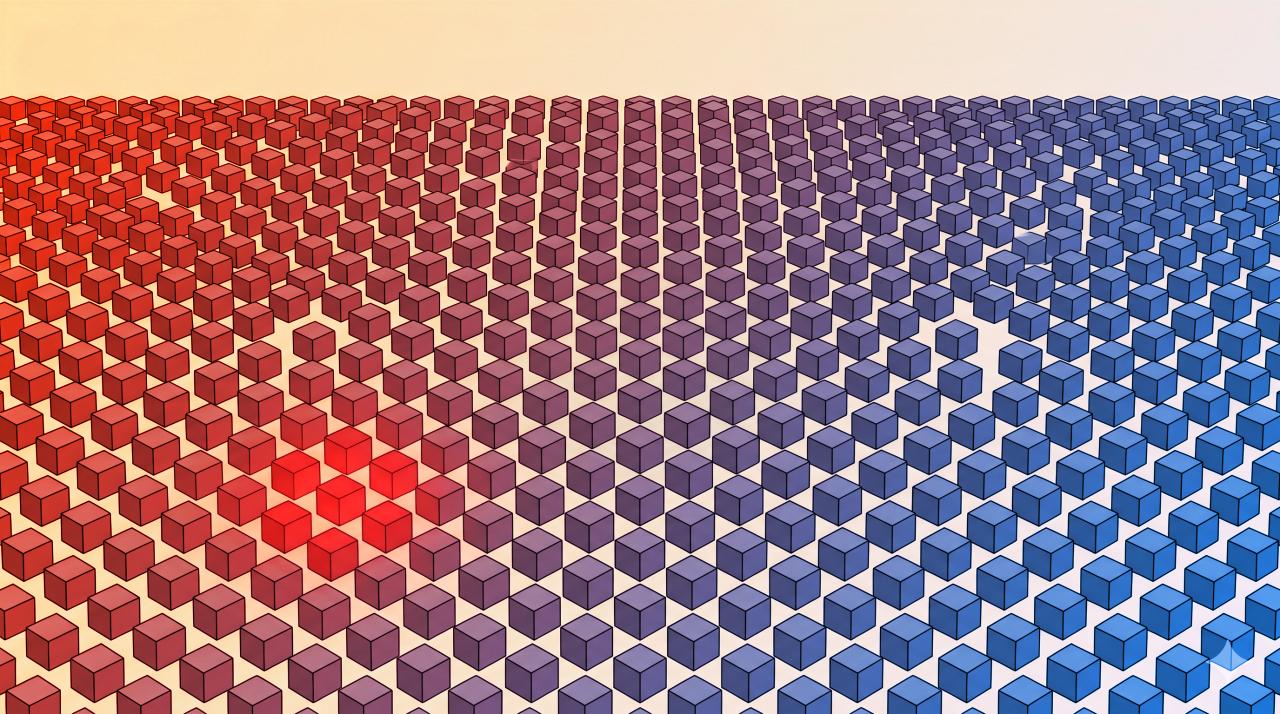

Token-fogyasztó vagy termelő leszel?

A vállalati MI-architektúra most nagy útelágazáshoz érkezett: mindenki eldöntheti, inkább „token-fogyasztóként” folyamatosan fizet egy külső szolgáltatónak, vagy „token-termelőként” saját infrastruktúrán állítja elő az MI-eredményt. Az önálló termelés nemcsak költségkérdés, hanem üzemeltetési és technológiai komplexitás is: a nagy kihívások közé tartozik az úgynevezett KV-cache perzisztenciája, a gyors tárhelystruktúra, a késleltetés határai, az adatközponti villamosenergia-kapacitás és az üzemeltetési bonyolultság.

Kritikus pont, hogy a kontextust (KV-cache) hagyományosan a GPU-memóriában tárolják, de ez limitálja a kiszolgált felhasználók számát és felemészti az erőforrásokat. Az újabb megoldások, mint a központosított, NVMe-alapú cache, egyszerre csökkentik a többletmemória-igényt és növelik az újrafelhasználás arányát, ám kompromisszumokat követelnek a rendszer sebessége terén.

Menekülés a „felhőspecialistákhoz” és a menedzselt inferenciához

Érdekes trend, hogy míg régen a felhőóriások általános infrastruktúráját vették igénybe, ma egyre több vállalat választ specializált MI-felhőszolgáltatókat (mint a Coreweave vagy a Lambda), amelyek már eleve inferencia-első logikára, optimalizált tárolóra és hálózatra építenek.

Ezzel párhuzamosan gyorsan nő azok száma is, akik inkább rábízzák a menedzselt nagy nyelvi modellre (Large Language Model, LLM) épülő szolgáltatókra az üzemeltetést – ennek aránya 13,2%-ról 23,1%-ra nőtt három hónap alatt. Ez a modell főként azoknak éri meg, akiknél a volumen nem indokolná a házon belüli komplexitást.

Az infrastruktúra új értelme: hármas vezérfonal

Az 5%-os kihasználtságból nem lehet „szimplán” jobb szoftverrel kitörni – strukturális átalakítás kell, főként a hálózat, a memória és a tárolóréteg összehangolásával.

A hálózatnál az RDMA (Remote Direct Memory Access) megszünteti a hagyományos sebesség- és késleltetési problémákat, így akár tízszer jobb kihasználtságot lehet elérni. A memóriapazarlást (memory tax) újragondolt, közös KV-cache-architektúrával lehet leszorítani. A tárolásban a modern, nagy teljesítményű rendszerek (Dell PowerScale, VAST Data AI OS) már elválasztják a gyors hozzáférést igénylő adatokat a GPU-któl, így csökkentve a tétlenül várakozó periódusokat.

Mindemellett a legújabb tömörítési eljárások (pl. Google TurboQuant) akár hatszoros memóriamegtakarítást tesznek lehetővé, feldolgozási kompromisszum nélkül.

Adatszuverenitás – a vállalati MI jövője

Ahogy a generatív MI világa az egyszerű chatbotoktól átlép az autonóm, ügynökalapú (agentic) rendszerekbe, a legnagyobb kockázat nem a technológiai, hanem a bizalmi szint lesz. Az ilyen ügynökök teljes belső adathozzáférést kapnak, ezért a szuverenitás (az adatok eredetének, felhasználásának, magyarázhatóságának minden pillanatban való kontrollja) architektúratervezési alapkérdéssé vált.

Itt már az a kérdés, hogy a MI-t vidd az adathoz vagy fordítva. A legtöbb stratégiánál a privát, vállalati „szuverén felhő” (sovereign cloud) vagy a saját környezet mellett döntenek, hogy garantálható legyen: az érzékeny adatok soha ne hagyják el a vállalat felügyeletét.

A fentiek tükrében

A hosszú időn át tartó GPU-halmozási láz mára kiderítette: az igazi verseny nem abban lesz, hogy ki halmoz fel több szilíciumot, hanem abban, ki tud gyorsabban és olcsóbban produktív eredményt (tokeneket) generálni, és mindezt megbízható adatalapon teszi. Aki most gyorsan és rugalmasan vált át hozamnövelő stratégiákra, lesz a következő generációs MI-verseny győztese – a többieknek marad az amortizációs vesszőfutás és a „használt, de ki nem fizetett” GPU-k nyomasztó öröksége.