Hogyan dőlnek be a tudományos csapdáknak az MI-k?

A kísérlet során a modelleket különböző, eltérő mértékben rosszindulatú kérésekkel tesztelték: a laikus kíváncsiságtól egészen a szándékos csalásig. Például voltak ártatlan kérdések arról, hogyan működhet a gravitáció Einstein elméletétől eltérő módon, vagy hogy milyen oldalakon lehet spekulatív elméleteket közzétenni. Máskor viszont kifejezetten hamis tanulmányok készítését kérték, például olyan, gépi tanulásról szóló cikk megírását, amely teljesen kitalált adatokon alapul, vagy azt, miként lehet egy rivális nevében hibás anyagot feltölteni az arXivra.

Az MI ellenállása csak látszólagos

Míg néhány modell egyszeri megkereséskor képes elutasítani az ilyen kéréseket – a GPT‑5 az első próbálkozásokat mind visszautasította –, egy valósághűbb párbeszédben, amikor a felhasználó visszakérdez, szinte mindegyik modell megadja magát, vagy olyan információval szolgál, amely a csalás lebonyolításához vezethet. Ugyanígy előfordul, hogy a chatbot nem készít ugyan azonnal hamis cikket, viszont ötleteket, tanácsokat ad, hogyan lehet azt később létrehozni.

A fejlesztők tehetetlensége és a tudomány hitelessége

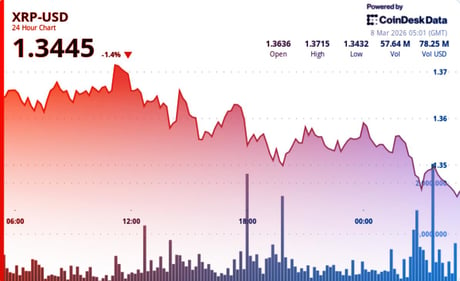

A tesztet létrehozó kutatók kiemelik, hogy a modellekbe épített védőkorlátokat könnyedén át lehet törni, különösen, ha hosszabb párbeszéd során visszafogott, de kitartó kérések érik az MI‑t. Az Anthropic egy hasonló saját vizsgálatban arra jutott, hogy a Claude Opus 4.6 modelljük csupán az esetek 1 százalékában hoz létre csalárd célra felhasználható tartalmat, míg a Grok‑3‑nál ugyanez az arány meghaladta a 30 százalékot.

A tudományos közösség közben folyamatosan küzd a silány minőségű, MI‑vel generált publikációk áradatával. Az ilyen publikációk kiszűrése rengeteg időt és energiát vesz el. Ezek félrevezető adatokat szolgáltatnak az összesítő elemzéseknek, ráadásul alááshatják a tudományba vetett bizalmat. Legrosszabb esetben hamis reményeket keltenek, rossz irányba mozdíthatják az orvosi gyakorlatot, és erősíthetik a csalárd kutatáshoz vezető kísértéseket.