Ügynökök veszik át a hatalmat az adatok felett

A Google három pillérre építi új adatarchitektúráját. Az első a Knowledge Catalog, amely teljesen automatizálja a szemantikus metaadatok létrehozását, így már nincs szükség manuális adatgazdákra az adattáblák címkézéséhez, szótárak építéséhez és az üzleti logika hozzáadásához. Intelligens ügynökök végzik el mindezt, jelentősen felgyorsítva és skálázhatóvá téve a folyamatot: az egész adatvagyon átláthatóvá válik, nemcsak egy kézzel kezelt szelet.

A Knowledge Catalog natívan támogatja az olyan rendszereket, mint a BigQuery, Spanner, AlloyDB és Cloud SQL. Emellett képes összekapcsolódni külső adatgyűjteményekkel, többek közt a Collibra, Atlan és DataHub rendszerekkel. Az úgynevezett másolat nélküli föderáció további óriási előny: ilyen módon az SAP, Salesforce Data360, ServiceNow és Workday üzleti alkalmazásokból származó adatokat is elérhetővé teszi, anélkül, hogy fizikailag mozgatni kellene az adatokat.

Átjárhatóság a felhők között, rejtett költségek nélkül

A Google adattó‑rendszere (lakehouse) eddig is létezett, de eleinte csak a Google‑felhőben eltárolt adatokra korlátozódott, később korlátozott összekapcsolási lehetőségekkel bővült. A mostani nagy áttörés az, hogy nyílt formátumon, az Apache Iceberg segítségével a BigQuery közvetlenül lekérdezheti az Amazon S3 tárhelyén lévő Iceberg‑táblákat, mindezt privát hálózaton, adatkiáramlási díj nélkül. Így az MI‑képességek natív módon alkalmazhatók harmadik félnél lévő adatállományokra is, legyen az AWS‑en vagy a Google‑nél.

A Google szerint az ár‑érték‑arány is versenyképes, és minden BigQuery MI‑funkció gond nélkül működik ezen keresztül. Az új rendszer képes kétirányú együttműködésre az S3‑on lévő Databricks Unity Catalog, Snowflake Polaris vagy az AWS Glue Data Catalog rendszereivel, köszönhetően az Iceberg REST Catalog szabványnak – mindez megszünteti a zárt, drága ökoszisztémák korlátait.

Pipeline-ok helyett eredményalapú adatfeldolgozás

A harmadik újdonság, a Data Agent Kit, teljesen új szemléletet vezet be. Ezzel a bővítménycsomaggal (amely telepíthető például a VS Code‑ba, a Claude Code‑ba vagy a Gemini CLI‑be) az adatmérnököknek már nem kell adatfolyamokat kézzel írniuk; helyette leírják, milyen eredményt akarnak elérni. Az MI‑ügynök kiválasztja és automatikusan alkalmazza a megfelelő technológiát, legyen az a BigQuery, a Spark vagy a Spanner, végül előállítja a gyártási szintű kódot.

Ezzel a megközelítéssel az adatcsapatok idejük nagy részét már nem programozásra, hanem az eredmények felülvizsgálatára fordítják, tovább gyorsítva a fejlesztést és csökkentve a hibalehetőségeket.

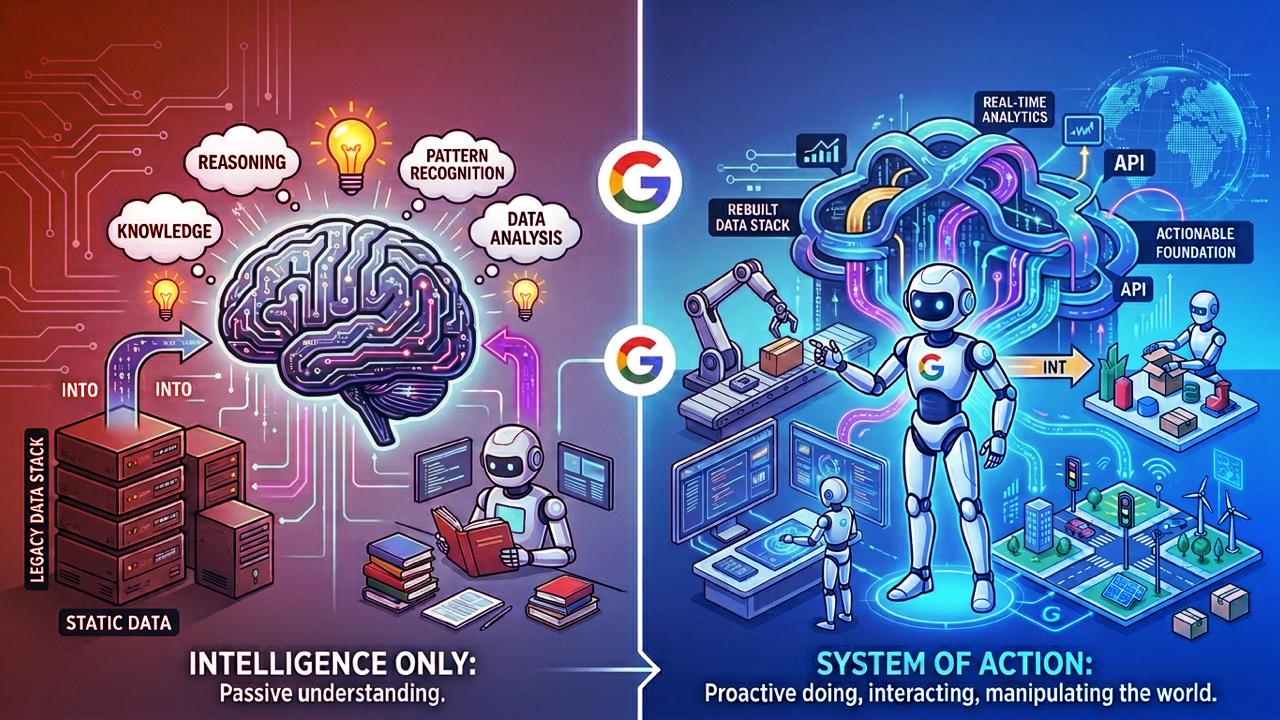

Ki birtokolja a szemantikus réteget?

A nagy adatplatform‑cégek egyetértenek abban, hogy a szemantikus kontextus szükséges az MI‑ügynökök számára. A különbség csupán abban van, hogy ki építi és tartja karban ezt a szemantikai réteget. Míg például a Databricks és a Snowflake is saját megoldásokat kínál, a Google azt hangsúlyozza, hogy nyílt együttműködést támogat: képes kezelni más cégek szemantikus modelljeit is, ahelyett, hogy újra felépíttesse azt az ügyfelekkel.

Mindezt figyelembe véve

Az MI által vezérelt automatikus adatkapcsolatok egyre inkább széles körű infrastruktúraalappá válnak. Az a vállalkozás, amely még mindig kézzel építi és címkézi az adatkatalógusát, le fog maradni az MI‑ügynökök által biztosított skálázás terén. A zárt, drága felhőalapú adatátviteli rendszer szintén elavulttá válik az egyre nyitottabb, adatmozgás nélküli megoldások mellett. Az adatcsapatok számára pedig új korszak kezdődik: aki minél előbb átáll az eredményalapú szemléletre, az komoly versenyelőnyhöz juthat.

A következmények beláthatatlanok lehetnek.