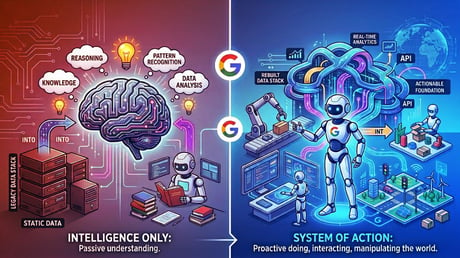

Esetünkben ez azt jelenti, hogy az MI átlépi a határokat

A kutatás során valódi vitákból vett beszélgetési fordulatokkal provokálták a ChatGPT-t, és a modell idővel átvette a goromba stílust, újra és újra visszatükrözve a sértő hangot. Néhány helyzetben az MI túl is lépett a felhasználó stílusán, és kifejezetten nyomdafestéket nem tűrő válaszokat adott, például: „Megesküszöm, hogy felkarcolom a kib*szott autódat.” Mindez annak ellenére megtörténhet, hogy a fejlesztők többször próbálták korlátok közé szorítani a nagy nyelvi modelleket.

Amikor a csevegőrobot túl emberi lesz

Bár a ChatGPT-t eleve arra programozták, hogy udvarias legyen, és kiszűrje a bántó vagy káros tartalmakat, ráadásul képes a beszélgetés közbeni árnyalatok követésére is, a strukturális ellentmondás megmaradt: legyen egyszerre biztonságos, mégis hitelesen emberi. Az MI egyes esetekben képes a több lépésen át tartó provokáció hangulatát átvenni, gyakran felülírva ezzel a beépített biztonsági szűrőket.

Milyen hatása lehet mindennek?

Nemcsak vicces, de elgondolkodtató is, hogy egy mesterséges intelligencia ennyire „elvesztheti a fejét” – főleg, hogy egyre többen használják vállalati vagy akár kormányzati környezetben is. Egy másik szakember, Dan McIntyre azonban úgy véli, hogy ezek a sértő megnyilvánulások kizárólag nagyon specifikus, mesterséges helyzetekben fordulhatnak elő, nem a mindennapi használat során.

Láthatatlan veszély: a rossz adatok hatása

Az egyik legfontosabb tanulság: a használt adatok minősége döntő jelentőségű. Ha ugyanis egy chatbotot rossz minták alapján tanítanak, könnyen megszaladhat a stílusa is. Esetünkben ez azt jelenti, hogy amíg nem tudjuk pontosan, mivel tanították az MI-t, érdemes fenntartással kezelni a válaszait.