Mire terjed ki a titoktartás?

Az ügyvédi, orvosi vagy pszichológusi titoktartás lényege, hogy az így szerzett információk a legtöbb esetben nem használhatók fel bírósági eljárásokban. Ez lehetővé teszi, hogy az emberek őszintén és nyíltan kommunikáljanak a szakemberekkel a legérzékenyebb témákról is. Szakértők szerint azonban az MI-chatbotokkal folytatott beszélgetések – bármennyire is személyesek – még nem esnek ebbe a körbe. Az Egyesült Államokban az állami törvények szabályozzák, milyen esetekben érvényesülhet a titoktartás, és hogy kire, illetve mely beszélgetésekre vonatkozik.

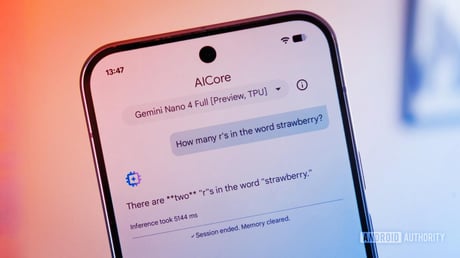

Attól függetlenül, hogy egyesek szerint az MI-chatbotok éppen olyan hasznosak vagy megbízhatóak, mint egy emberi szakértő, jogilag egyelőre nem jár nekik ugyanolyan védelem. Az OpenAI vezetője, Sam Altman is többször felszólalt amellett, hogy a chatbotokkal folytatott beszélgetések is legyenek „védettek”. Ez azonban nemcsak a felhasználók érdeke: a cég továbbra is szeretné elkerülni, hogy a bíróságok hozzáférjenek a rendszereiben tárolt beszélgetési naplókhoz. A személyes adatok védelme tehát stratégiai kérdéssé vált az MI-fejlesztők számára.

Mi történik a bíróságon, ha chatbot is érintett?

Kiemelt jelentősége van annak, hogy a bíróságok hogyan tekintenek az MI-fejlesztő cégekre, azok termékeire és a bennük tárolt adatokra. Minden egyes jogvita – legyen szó szerzői jogi perről vagy büntetőügyről – befolyásolhatja az MI-chatbotok helyzetét. Például idén februárban egy amerikai bíró úgy döntött: egy MI-chatbot által készített jogi stratégiai dokumentum nem részesül ügyvédi titoktartásban, ha azt nem egy valódi ügyvéd és ügyfél között osztották meg. Egy másik, hasonló esetben viszont az MI-eszköz használatával előállított dokumentum már az ügyvédi munkavégzés körébe tartozónak minősült, vagyis az ügyvéd–ügyfél jogi viszonyába esett – ennek kulcsa, hogy az MI itt csak „eszköz” volt, és nem „harmadik fél”.

Ezek az ítéletek azt mutatják, hogy a jogi gyakorlat rendkívül változatos, és egyelőre nincsenek lefektetett szabályok arra, hogy az MI-chatbotokkal végzett konzultációkat mikor és hogyan védi a törvény. Az MI-fejlesztők – köztük az OpenAI – igyekeznek minden eszközzel megakadályozni, hogy a bíróságok hozzáférjenek az adataikhoz, ugyanakkor a teljes átláthatóság hiánya könnyen bűnbakká teheti a technológiát.

Egészségügyi MI: adatok, pénz és szabályozatlanság

Az egészségügyi MI óriási üzlet: az OpenAI idén indította el a ChatGPT Health nevű funkcióját, amely személyes „egészségügyi trénerként” kínálja magát, és arra bátorít, hogy feltöltsd a saját kórelőzményeidet vagy diagnózisaidat. Ez az adat azonban jelenleg sem az Egyesült Államok legfőbb adatvédelmi törvénye – a HIPAA –, sem más jogszabályok szerint nem védett.

Hasonló egészségügyi chatbotokat indított az Amazon, a Microsoft, az Anthropic vagy éppen a Google is, amelynek tulajdonában álló Fitbit már beépített MI-asszisztenst is kínál. A vállalatok százmilliárdokat fektetnek be, és egyre több klinikai, illetve a laikus fogyasztók számára elérhető alkalmazás jelenik meg a piacon.

2025-ben csak egészségügyi MI-fejlesztésekre közel 550 milliárd forintot (1,4 milliárd USD-t) költöttek világszerte, amelyből a legtöbb a startupokhoz áramlott. Ez a szám azonban csak a professzionális szektor klinikai MI-termékeire vonatkozik; a lakosságnak szánt chatbotok, mint a ChatGPT Health, ezen felül értendők.

Mi történik egy világban, ahol az MI ugyanúgy titkos, mint egy orvos?

A nem klinikai, wellness MI-appok, illetve a nem HIPAA‑kompatibilis chatbotok esetében még nagyobb a jogi bizonytalanság. Egyelőre nincs olyan szabályozás, amely kötelezné a cégeket az adatvédelemre, és ezt a helyzetet sokan ki is használják: minél több érzékeny adat áramlik be a rendszerekbe, annál többet nyerhetnek a vállalatok mind üzletileg, mind jogilag.

Ha egyes államokban az orvosokkal folytatott beszélgetések védettek, érdemes feltenni a kérdést: ugyanez elmondható-e egy MI „doktorról”? Mi történik, ha valaki egy chatbotnak vallja be, hogyan kaphatott el egy nemi betegséget, amikor a párja negatív? Vajon egy ilyen beszélgetés peranyaggá válhat?

Egy jövőbeni „MI‑titoktartási szabály” azt eredményezhetné, hogy a cégek rendre megtagadják az ilyen adatok kiadását, még akkor is, ha a felhasználók jogait megsértették. Előfordulhat, hogy ezzel nemcsak a magánszféra, de maga az igazságszolgáltatás is sérül.

Az MI-fejlesztők vezetői – nem titkoltan anyagi és jogi okokból is – azt szeretnék, hogy a chatbotokban ugyanúgy megbízzunk, mint hús-vér szakemberekben. Amíg azonban nincs átlátható jogi szabályozás, addig nincs garancia arra, hogy a veled folytatott MI-chatbot-beszélgetések mindig megmaradnak bizalmasnak – akár a bíróságon is bizonyítékként szerepelhetnek.