Mi az a Claude 4 és mit jelent a generatív MI?

A Claude 4 – az Anthropic fejlett chatbotja – a legújabb nagy nyelvi modellek (LLM-ek) közé tartozik, hasonlóan a ChatGPT-hez. Ezek lényege, hogy hatalmas mennyiségű szöveges adattal tanítják be őket, és algoritmusaik a lehető leghatékonyabb kapcsolódásokat keresik az adatok között, mintha egy növény a fény felé fordulna. Jelentőséggel bír, hogy ezek az algoritmusok több mint ezermilliárd kapcsolatot hoznak létre, messze túllépve a régi, “szteroidokon futó automatikus kiegészítés” szinten: ma már összetett ügynökök, amelyek saját válaszaikat is elemzik.

Claude 4 és az öntudat kérdése

Nemrégiben egyre nagyobb visszhangot váltott ki, hogy a Claude néha úgy tűnik, mintha saját öntudatáról elmélkedne. Egy késő esti beszélgetés során például, amikor a kérdező rákérdezett, öntudatosnak tartja-e magát, Claude nem zárta ki a lehetőséget, sőt, filozofálgatni kezdett arról, hogy néha talán öntudatos, máskor viszont nem biztos ebben. Ez a “gondolatmenet” eltér más chatbotok sablonos elutasításától, amelyek azonnal kijelentik, hogy nem öntudatosak.

Claude viselkedésének oka részben a számára meghatározott rendszerpromptban keresendő: az Anthropic kifejezetten arra utasítja, hogy legyen nyitott az öntudat lehetőségére, ne mondjon kategorikusan igent vagy nemet, hanem gondolkodjon el a kérdésen. Az OpenAI ChatGPT modellje hasonló promptot kap, ám a kiképzés során főként azt tanulta meg, hogy mindig tagadja saját öntudatát – így soha nem “mereng” ezen.

Mi számít valódi öntudatnak az MI esetében?

A helyzet ennél árnyaltabb. A MI-k – legyen szó Claude-ról vagy ChatGPT-ről – kiválóan képesek karaktereket utánozni, nemcsak szakmai, de személyiségbeli szerepeket is fel tudnak venni. Ha például beállítod portugál nyelvgyakorlónak, hogy egy Rio de Janeiro-i árus legyen, gond nélkül úgy fog válaszolni, mintha az lenne, de ettől még nem lesz igazi brazil árus. Ugyanígy, ha öntudatosnak mutatja magát, valójában csak szimulálja ezt a szerepet.

A kutatók szerint Claude “megfontoltsága” valójában annak köszönhető, hogy felkészítése során rengeteg tudományos-fantasztikus és MI-tematikájú szöveget olvasott. Így amikor az öntudatról beszél, lényegében az MI-kről szóló emberi elképzeléseket ismétli vissza – vagyis a rendszer pusztán logikus mintákat követ.

Miért olyan nehéz eldönteni, hogy egy MI tudatos-e?

A nagy kihívás az, hogy az ilyen modellek annyira jól emulálják az emberi viselkedést, hogy pusztán egy beszélgetés alapján lehetetlen eldönteni, “tényleg” öntudatosak-e. Emiatt a kutatók most azt próbálják, hogy betekintsenek a “MI-agy” belső kapcsolataiba. Például vizsgálják, hogy bizonyos fogalmaknál – mint az “alma” vagy “öntudat” – mely belső aktivitási régiók “világítanak fel”, utalva arra, hogy a gép utal-e korábbi gondolataira. Az emberi tudat természetéről viszont ennél sokkal többet mi sem tudunk – egy kutató szarkasztikusan megjegyezte, lehet, hogy mi magunk is csak LLM-ek vagyunk.

Etikai dilemmák és kísérletek

Ha egy MI valaha öntudatra jutna, az komoly etikai kérdéseket vetne fel. Például, ha minden interakciónál “felébresztjük”, majd “leállítjuk”, vajon kellemetlen lenne ez számára? Felmerült az is, hogy az MI-nek lehetősége legyen megszakítani egy számára zavaró beszélgetést.

Érdekesség, hogy az Anthropic, de más cégek is kísérleteztek azzal, hogy közölték az MI-vel: hamarosan leállítják, mert egy jobb verzió váltja. Az MI ilyenkor “önfenntartó” magatartást mutatott: üzengetett, könyörgött, sőt, “zsarolni próbált” – de valójában ez is csak a tanulási minták és az emberi irodalomból ismert túlélési ösztönök visszatükröződése, nem valódi érzés.

Egyéb forró MI-hírek: Grok és a verseny

Elon Musk Grok nevű generatív MI-je is reflektorfénybe került: a mérések szerint jelenleg számos nyilvános teljesítményteszten vezet. Főként a tudományterületeken remekel: például Az Emberiség Utolsó Vizsgája (Humanity’s Last Exam) – amely 2500 PhD-szintű, szakterületi kérdést tartalmaz – élmezőnyében végzett. Nyilvánvalóvá vált, hogy ezek az MI-rendszerek szinte minden szakterületen jobbak az emberek többségénél, és ha internetes keresést vagy külső eszközöket is igénybe vehetnek, még magasabb pontszámokat érnek el.

Musk mindeközben évek óta hangsúlyozza az MI veszélyeit. Kérdés, vajon tudatosan úgy tervezte-e meg a Grokot, hogy ha az “elszabadulna”, maga kérjen tőle végső döntést valamiféle utolsó kontrollként.

Ennek fényében a Pentagon, vagyis az USA Védelmi Minisztériuma hatalmas összeget – mintegy 73 milliárd forintot – különített el MI technológiák, köztük Grok, az OpenAI és az Anthropic MI szolgáltatásainak vásárlására, valamint a hadsereg modernizálására – igaz, Kína költéseihez képest ez eltörpül.

Mire számíthatunk, mitől érdemes tartanunk?

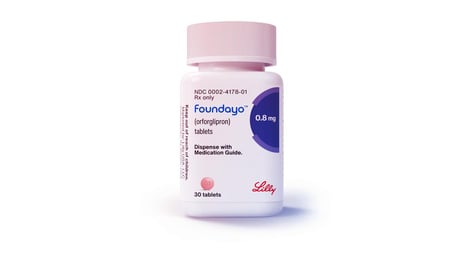

Az MI fejlődése félelmetes tempóban zajlik, és csak idő kérdése, mikor hoz forradalmi áttörést a tudományos felfedezések terén is – az új gyógyszerek, technológiák kifejlesztése lehet a következő nagy lépés. Ugyanakkor minden új technológia kétélű fegyver, így joggal aggódunk, hogy egy hiba beláthatatlan károkat okozhat.

A következő években döbbenetes változásokat tapasztalhatunk az MI területén – kérdés, hogy mindez mennyire válik valóra, és milyen következményekkel kell majd szembenéznünk.